计算机视觉研究院-YoloV10部署落地用于实时嵌入式目标检测附论文下载

计算机视觉研究院 | YoloV10部署落地:用于实时嵌入式目标检测(附论文下载)

本文来源公众号 “计算机视觉研究院” ,仅用于学术分享,侵权删,干货满满。

原文链接:

标题 :YOLOv10: Real-Time End-to-End Object Detection

论文 :

源码 :

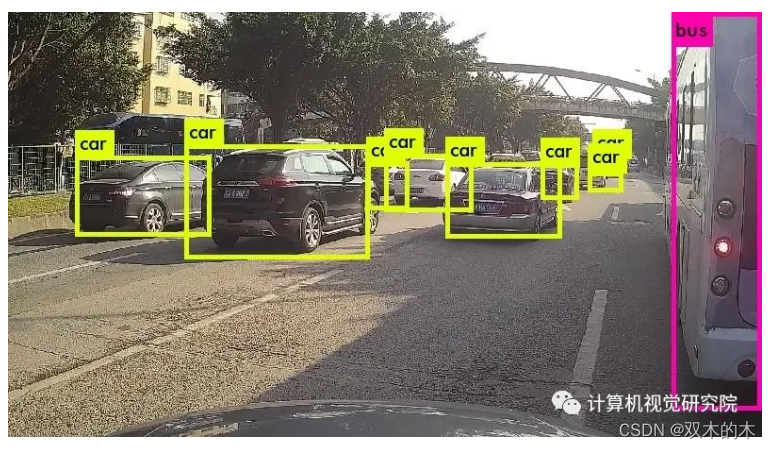

YOLO系列 是当前最主流的端侧目标检测算法,随着时间发展,已经推出了多个版本,每个版本“似乎”都在性能和速度上有所提升。今天基于YOLOv10实现部署落地!

一、前言

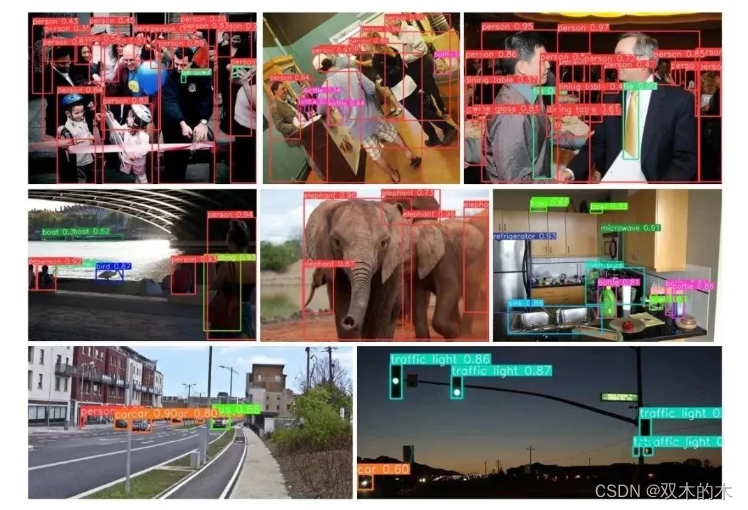

目标检测被认为是计算机视觉领域中最具挑战性的问题之一 ,因为它涉及场景中对象分类和对象定位的组合。最近,与其他方法相比, 深度神经网络 (DNN) 已被证明可以实现卓越的目标检测性能,其中YOLO是基于DNN的最先进技术之一。

目标检测方法在速度和准确性方面。尽管YOLO可以在强大的GPU上实现实时性能,但在计算能力和内存有限的嵌入式计算设备上利用这种方法进行视频中的实时目标检测仍然非常具有挑战性。

二、概要

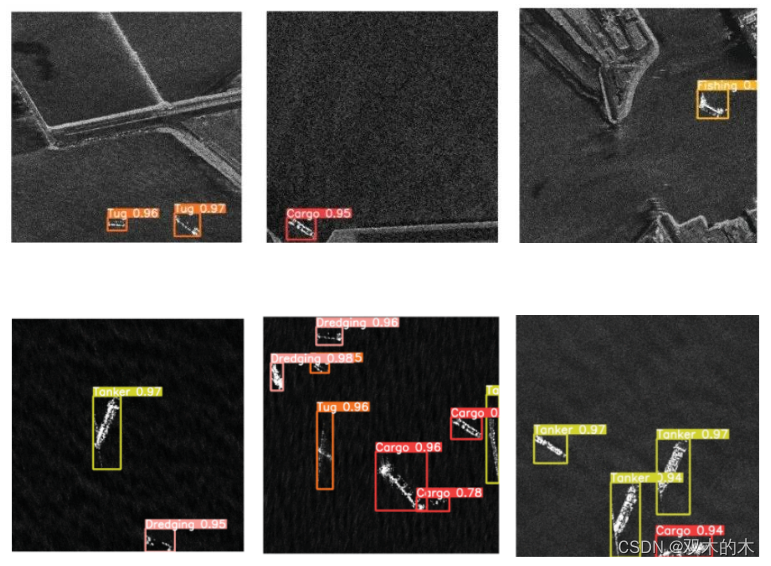

在今天分享中,有研究者提出了一个 YOLOv10 的新框架,这是一个快速的You Only Look Once框架,它可以加速以便能够以实时方式在嵌入式设备上执行视频中的目标检测。

首先,利用进化深度智能框架来进化YOLO网络架构,并产生一个优化的架构,其 参数减少了2.8倍 , IOU下降了约2% 。为了在保持性能的同时进一步降低嵌入式设备的功耗,在提出的YOLO框架中引入了一种运动自适应推理方法,以降低基于时间运动特性的深度推理的频率。实验结果表明,与原始YOLOv8相比,所提出的框架可以将 深度推理的数量平均减少38.13% , 视频中目标检测的平均加速约为3.3倍 ,导致运行在Nvidia Jetson TX1嵌入式系统上平均约为18FPS。

三、新框架

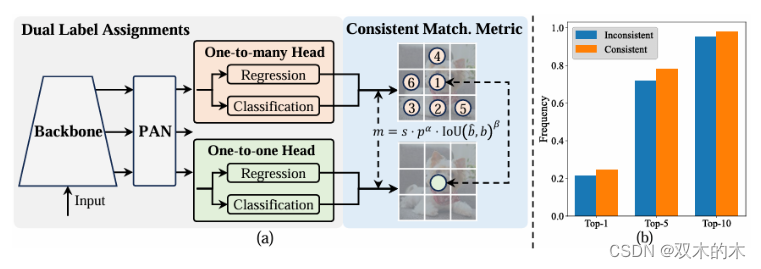

在训练期间,YOLOs通常利用TAL为每个实例分配多个阳性样本。一对多分配的采用产生了丰富的监控信号,有助于优化并实现卓越的性能。然而,YOLO必须依赖NMS后处理,这导致部署的推理效率不理想。虽然以前的工作探索一对一匹配来抑制冗余预测,但它们通常会引入额外的推理开销或产生次优性能。在这项工作中,为YOLO提供了一种无NMS的训练策略,该策略具有双标签分配和一致的匹配度量,实现了高效率和有竞争力的性能。

深度神经网络的主要挑战之一,尤其是在将它们用于嵌入式场景时,是网络架构设计。设计过程通常由人类专家执行,他探索大量网络配置,以在建模精度和参数数量方面为特定任务找到最佳架构。寻找优化的网络架构目前通常作为超参数优化问题来解决,但这种解决问题的方法非常耗时,而且大多数方法对于大型网络架构来说要么在计算上难以处理,要么导致次优解决方案不够嵌入式使用。

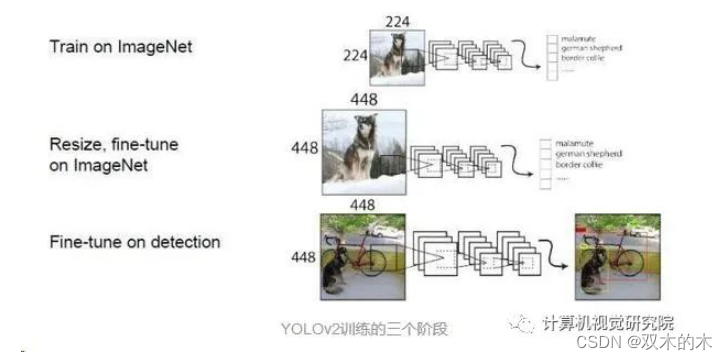

例如,超参数优化的一种常用方法是网格搜索,其中检查大量不同的网络配置,然后选择最佳配置作为最终的网络架构。然而,为视频中的目标检测而设计的深度神经网络(如YOLOv2)具有大量参数,因此在计算上难以搜索整个参数空间以找到最佳解决方案。

因此,研究者没有利用超参数优化方法来获得基于YOLOv8的最佳网络架构,而是利用专为提高网络效率而设计的网络优化策略。特别是,研究者利用进化深度智能框架来优化网络架构,以合成满足嵌入式设备内存和计算能力限制的深度神经网络。

为了进一步降低处理器单元的功耗,用于视频中的嵌入式目标检测,研究者利用了这样一个事实,即并非所有捕获的视频帧都包含唯一信息,因此不需要对所有帧进行深度推理。因此,研究者引入了一种运动自适应推理方法来确定特定视频帧是否需要深度推理。通过在必要时使用前面介绍的网络进行深度推理,这种运动自适应推理技术可以帮助框架减少对计算资源的需求,从而显着降低功耗系统以及处理速度的提高。

四、实验

THE END !

文章结束,感谢阅读。您的点赞,收藏,评论是我继续更新的动力。 大家有推荐的公众号可以评论区留言,共同学习,一起进步。